Яндекс открыл технологию MADrive для виртуального тестирования беспилотников

Исследователи Яндекса представили MADrive и датасет MAD-Cars для создания фотореалистичных дорожных сцен: технология заменяет реальные автомобили в видео на 3D-модели и генерирует опасные ситуации — резкие перестроения, обгоны, торможения — для безопасного обучения алгоритмов автономного вождения.

- MADrive воссоздаёт дорожные сцены и подменяет реальные машины фотореалистичными 3D-моделями с учётом ракурса, глубины и освещения

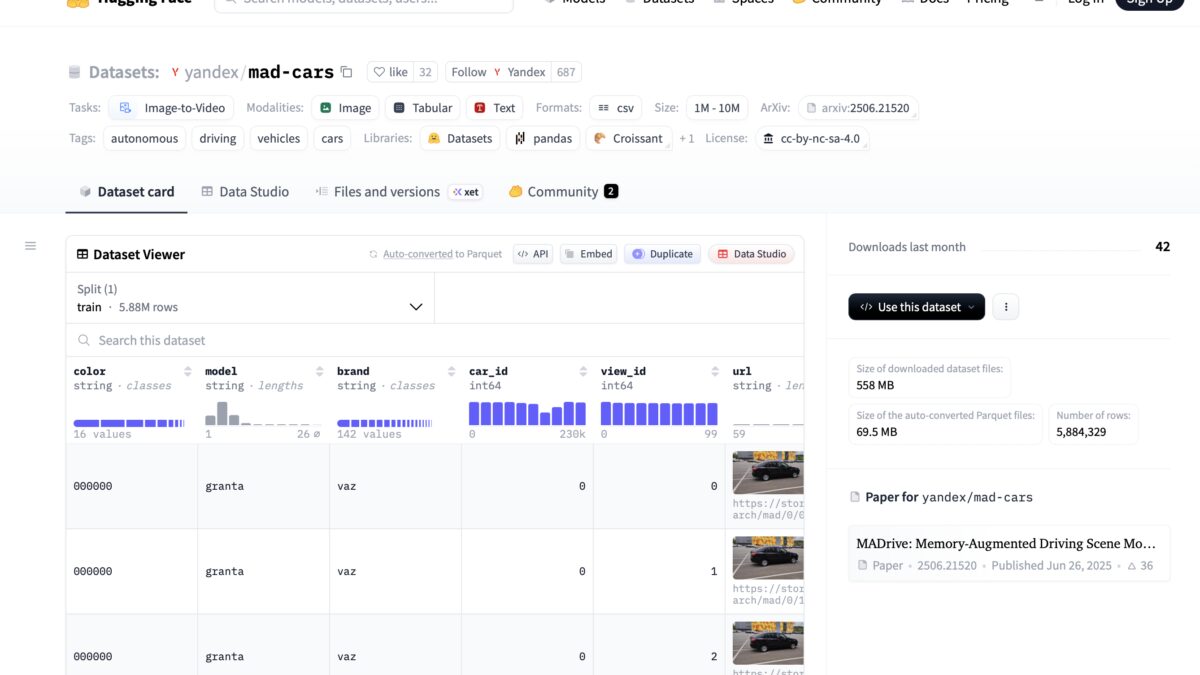

- Датасет MAD-Cars содержит около 70 тысяч видеозаписей более 150 марок автомобилей — один из крупнейших открытых наборов данных такого типа

- Технология позволяет генерировать новые дорожные ситуации: менять траектории, моделировать критические манёвры, которые невозможно воспроизвести на реальной дороге

Яндекс представил технологию MADrive и выложил в открытый доступ датасет MAD-Cars для создания реалистичных виртуальных дорожных сцен. Разработки позволят исследователям и инженерам по всему миру безопасно тестировать редкие и опасные дорожные ситуации, чтобы делать автономный транспорт надёжнее и безопаснее.

Замена реальных машин на 3D-модели в видео

MADrive воссоздаёт дорожную сцену и заменяет реальные машины в видео на фотореалистичные 3D-модели. Модели подбираются так, чтобы максимально совпадать с реальными автомобилями по форме и цвету, а затем встраиваются в сцену с учётом ракурса, глубины и освещения. Благодаря этому виртуальные проезды выглядят естественно и подходят для обучения и проверки алгоритмов автономного вождения.

MADrive позволяет не только воспроизводить реальные поездки, но и создавать новые дорожные ситуации: менять траектории автомобилей, моделировать резкие перестроения, неожиданные торможения, обгоны и другие сложные манёвры.

В основе технологии лежит открытый датасет MAD-Cars — набор обезличенных видеороликов машин разных марок, моделей и цветов, снятых с разных ракурсов в реальных условиях. Датасет включает около 70 тысяч видеозаписей более 150 марок автомобилей, что делает его одним из крупнейших открытых наборов данных такого типа.

Решение проблемы нехватки данных в симуляторах

«Симуляторы — важная часть разработки автономного транспорта: в них алгоритмы учатся и проходят проверку без выезда на реальную дорогу. Однако у симуляторов, воспроизводящих реальные проезды, существует проблема нехватки данных. Например, если в реальности машина повернула налево, мы не сможем показать, как она выглядела бы при обгоне или резком перестроении. Наш подход снимает это ограничение: теперь мы можем создавать новые дорожные сцены, которые выглядят так же естественно, как если бы они были сняты на видео. Это открывает путь к безопасному тестированию редких и критических ситуаций, которые невозможно организовать на реальной дороге», — говорит Виктор Юрченко, руководитель группы симуляции сенсоров автономного транспорта Яндекса.

В экспериментах технология показала более высокие показатели качества по сравнению с существующими методами визуальной реконструкции сцен, особенно там, где нужно не просто повторить запись, а сгенерировать продолжение или новый вариант развития событий.

Команда инженеров автономного транспорта Яндекса и исследователи лаборатории Yandex Research подготовили подробную техническую статью на Хабре с описанием подхода и результатами экспериментов. Технология открывает исследователям по всему миру путь к созданию симуляторов нового поколения, которые обеспечат более фотореалистичное и вариативное моделирование. В будущем планируется расширить базу автомобилей и улучшить алгоритмы освещения, чтобы сделать симуляции ещё более приближёнными к реальности.