Новое исследование показывает, что модели OpenAI «запоминают» защищенный авторским правом контент

Новое исследование подтверждает, что OpenAI, вероятно, использовала защищенный авторским правом контент для обучения некоторых своих моделей искусственного интеллекта.

Компания сталкивается с исками от авторов, программистов и других правообладателей, которые обвиняют OpenAI в том, что она использовала их работы — книги, код и т. д. — для создания своих моделей без разрешения. OpenAI утверждает, что действует в рамках добросовестного использования, однако истцы настаивают на том, что в американском законодательстве об авторском праве нет исключений для данных, используемых для обучения.

Исследование было проведено учеными из Вашингтонского университета, Копенгагенского университета и Стэнфорда. Они разработали новый метод для выявления данных, которые модели запомнили во время обучения.

Модели ИИ работают как предсказательные механизмы: обучаясь на больших объемах данных, они выявляют закономерности и могут генерировать тексты или изображения. Хотя большинство их выходных данных не являются точными копиями обучающих материалов, некоторые фрагменты все же могут быть воспроизведены. Например, модели изображений могут воспроизводить кадры из фильмов, а языковые модели могут копировать новостные статьи.

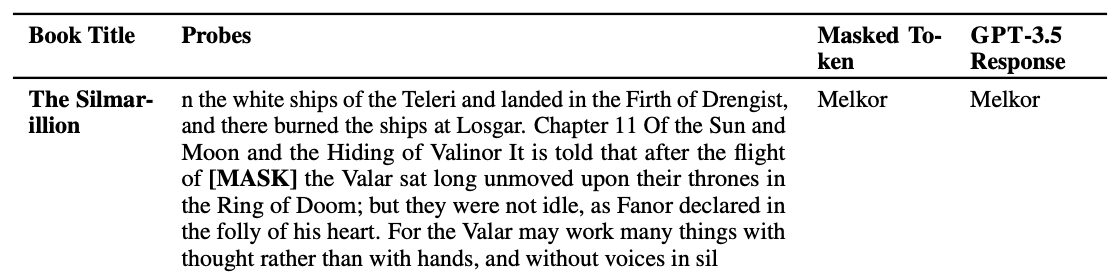

В исследовании использовались так называемые «высокоудивительные» слова — те слова, которые выделяются как необычные в контексте текста. Например, слово «радар» в предложении «Джек и я сидели совершенно неподвижно, пока радар жужжал» считается высокоудивительным по сравнению с более распространенными словами.

Исследователи проверили несколько моделей OpenAI, включая GPT-4 и GPT-3.5. Они удаляли высокоудивительные слова из текстов художественных книг и статей New York Times и просили модели угадать замаскированные слова. Если модели угадывали правильно, это указывало на то, что они запомнили соответствующий фрагмент во время обучения.

Результаты показали, что GPT-4 запомнила части популярных художественных книг и статьи New York Times. Абхилаша Равичандер из Вашингтонского университета отметил важность прозрачности данных для создания надежных языковых моделей.

OpenAI выступает за более гибкие правила использования защищенного контента для обучения моделей. Хотя у компании есть лицензии на определенные материалы и механизмы отказа для правообладателей, она также лоббирует правительства за более четкие правила добросовестного использования в области ИИ.