Claude Opus 4.7 усилил кодинг и зрение

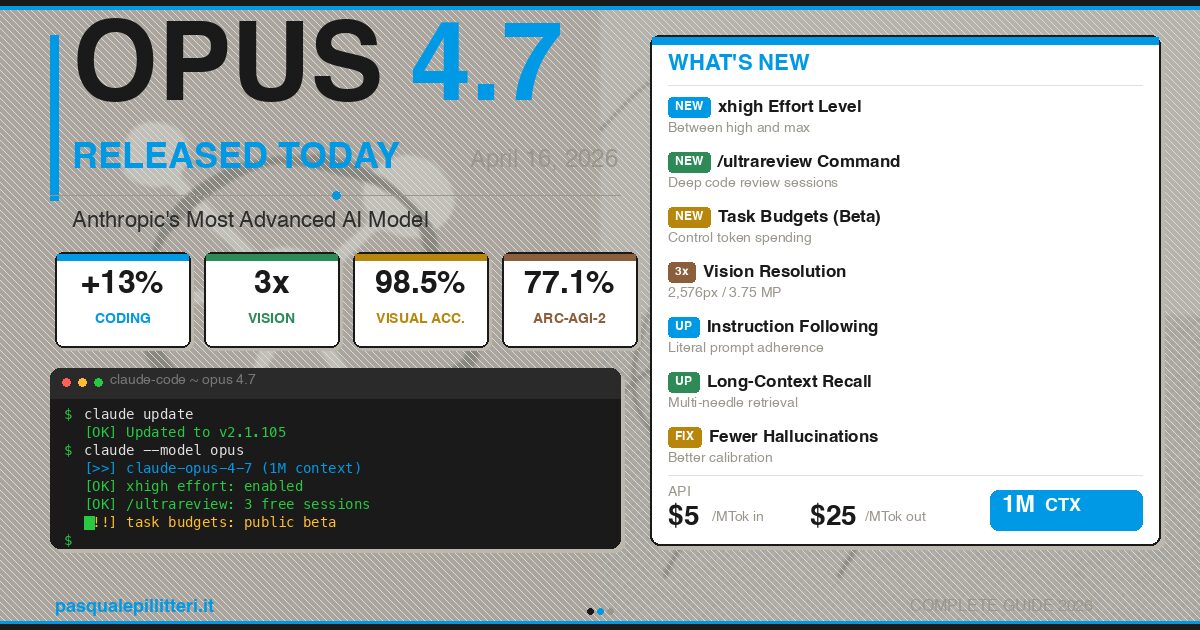

Anthropic выпустила Claude Opus 4.7, и это не очередная косметическая заплатка для галочки. Модель прибавила 13% в задачах программирования, получила утроенное разрешение для работы с изображениями и довела точность визуального распознавания при управлении компьютером до 98,5%.

Самое любопытное здесь не один громкий процент, а то, как Anthropic продаёт этот апдейт: не как «ещё одну версию», а как инструмент для разработчиков, которые устали от моделей, красиво рассуждающих и плохо чинящих код. Рынок ассистентов сейчас живёт именно этим конфликтом, поэтому улучшения в кодинге, документах и agent-задачах выглядят не украшением, а попыткой занять место там, где конкурируют OpenAI, Google и GitHub Copilot.

Claude Opus 4.7 и его параметры

Claude Opus 4.7 доступна под ID claude-opus-4-7 и работает на API Anthropic, Amazon Bedrock, Google Cloud Vertex AI и Microsoft Foundry. Контекстное окно осталось на уровне 1 миллиона токенов, но внутри Anthropic переработала извлечение данных из длинных контекстов, так что модель меньше теряет важные куски в огромных кодовых базах и длинных диалогах.

Opus 4.7 остаётся флагманом для коммерческого использования, но не самым мощным вариантом Anthropic вообще. Для закрытых тестов у компании есть Claude Mythos, а Opus, как обычно, отдувается за публичный продукт и за деньги клиентов.

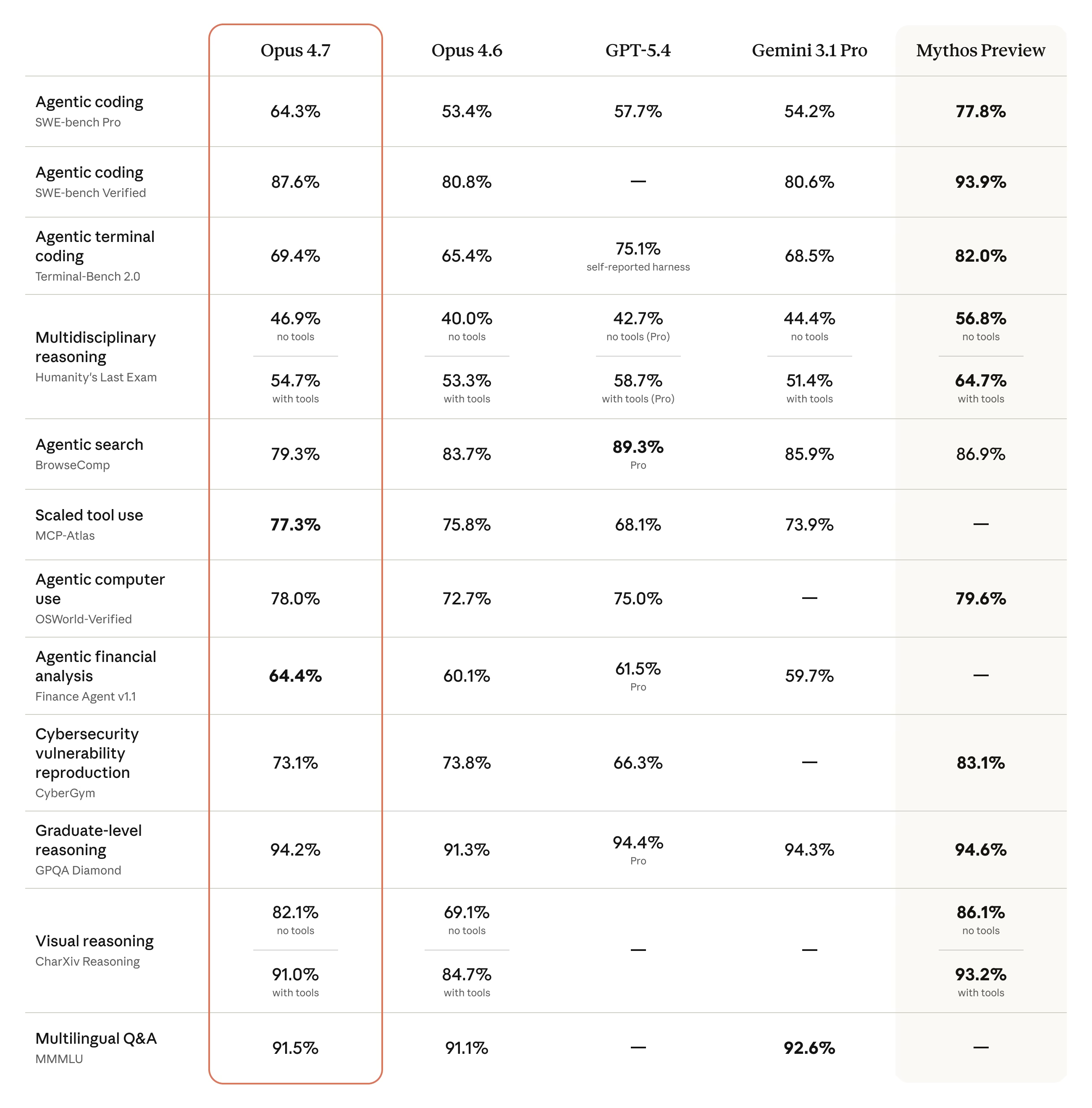

Бенчмарки Claude Opus 4.7

По официальным данным Anthropic, модель показала плюс 13% на бенчмарке из 93 задач по кодированию, в три раза лучше решила продакшн-задачи на Rakuten-SWE-Bench и набрала 70% на CursorBench против 58% у Opus 4.6. Для тех, кто живёт в рефакторинге, отладке гонок и прочих радостях большого кода, это уже не маркетинговый шум, а вполне ощутимая разница в количестве ручных исправлений.

В общем, модель получила 77,1% на ARC-AGI-2. Anthropic подаёт это как подтверждение лидерства в абстрактном мышлении, но полезнее смотреть на практику: Opus 4.7 заметно лучше следует инструкциям, а значит, меньше импровизирует там, где пользователю нужна не поэзия, а точное выполнение задания.

Есть и обратная сторона: обновлённый токенизатор увеличивает расход токенов примерно в 1,0—1,35 раза в зависимости от типа контента. То есть качество выросло, а счёт за это, как водится, никто не отменял.

Визуальные функции Claude Opus 4.7

Главный рывок вне кода — зрение. Opus 4.7 обрабатывает изображения с разрешением до 2576 пикселей по длинной стороне, что примерно соответствует 3,75 мегапикселя и более чем в 3 раза выше прежнего потолка. Это напрямую бьёт по задачам с диаграммами, химическими структурами, скриншотами интерфейсов и отсканированными документами.

Именно здесь цифра 98,5% важнее всех красивых слов про «умную» модель. Автоматическое управление компьютером перестаёт быть аттракционом с частыми падениями, а анализ PDF и презентаций начинает походить на рабочий инструмент, а не на демо для сцены. В юридических, финансовых и технических сценариях это уже не улучшение в процентах, а разница между экономией времени и вечной проверкой за машиной.

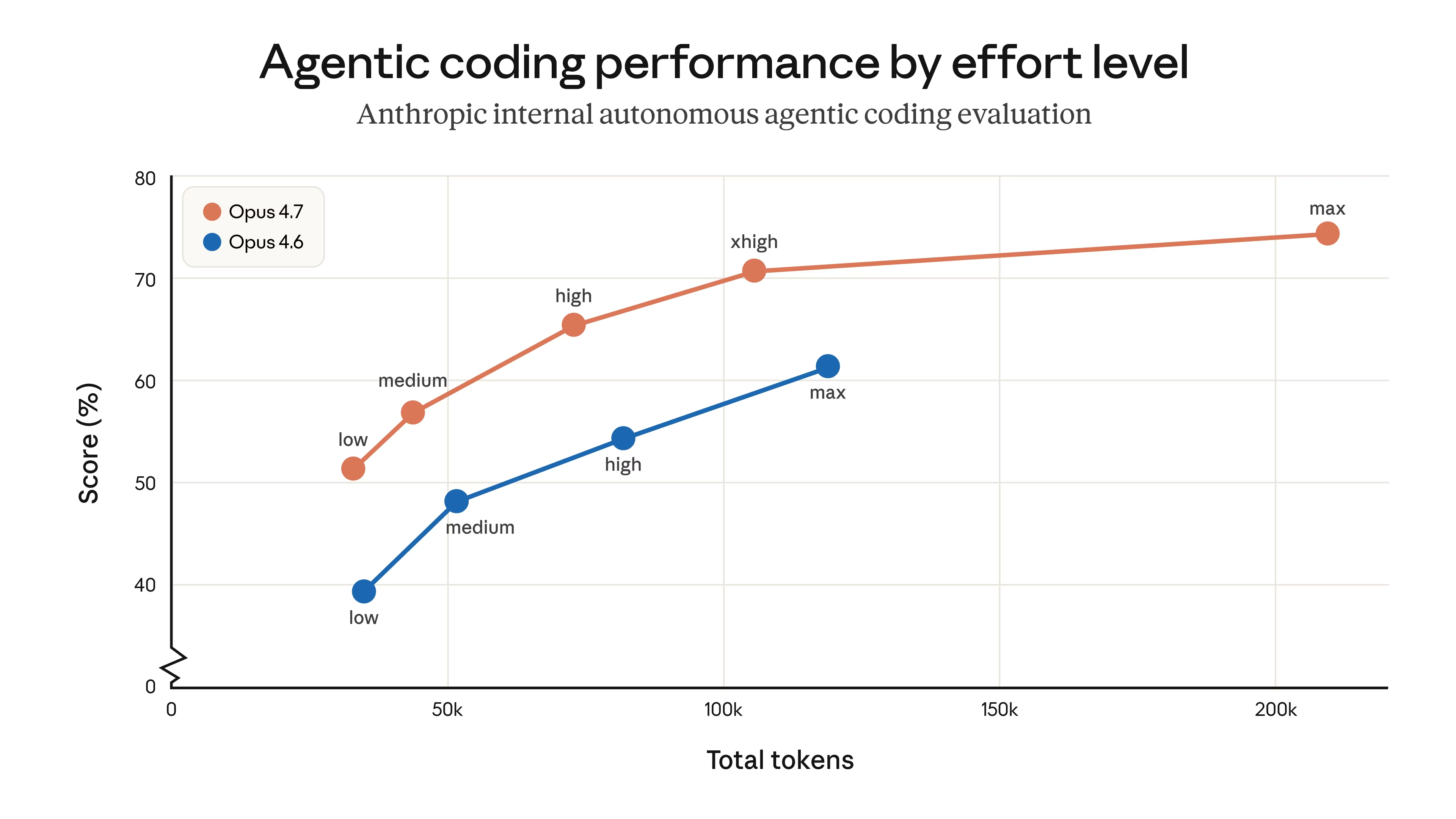

xhigh, /ultrareview и Task Budgets

Anthropic добавила три вещи, которые интересны не всем, а тем, кто реально платит за результат. Уровень усилий xhigh стоит между high и max, команда /ultrareview запускает углублённое код-ревью, а Task Budgets в бете позволяют ограничивать расход токенов на длинных задачах, чтобы рефакторинг целого модуля не превратился в маленькую финансовую трагедию.

Ещё один штрих для аккуратных пользователей. Auto Mode теперь доступен и для Max, а псевдоним opusplan позволяет планировать на Opus 4.7 и выполнять код уже на Sonnet, если хочется сэкономить без полного отказа от более сильного рассуждения на этапе планирования.

- вход: $5 за миллион токенов;

- выход: $25 за миллион токенов.

Практический вывод тут очевиден без финального спектакля. Если ваши промпты были написаны под более «свободные» модели, с Claude Opus 4.7 они могут начать работать жёстче и буквальнее, а значит, старые формулировки придётся чистить вручную, как и всё, что в ИИ-проектах почему-то называют «почти готовым».