Перегрев в AWS задел Coinbase и вскрыл проблему ИИ-стоек

Сбой в одном из дата-центров Amazon 8 мая ударил по клиентам AWS, включая Coinbase: часть облачных сервисов легла из-за перегрева серверов, а полное восстановление заняло несколько часов. Amazon перебросила нагрузку в другие зоны доступности, но история неприятная по простой причине: у крупнейшего облака мира все чаще ломается не софт, а физика.

Это уже не редкая авария «где-то в машинном зале». AWS держит около трети мирового облачного рынка, и любой сбой такого масштаба мгновенно бьет по биржам, SaaS-сервисам и внутренним системам компаний, которые любят рассказывать про отказоустойчивость в презентациях. Когда перегрев цепляет инфраструктуру, красивые схемы резервирования быстро превращаются в очень дорогую теорию.

Перегрев в дата-центрах AWS и ИИ-стойки

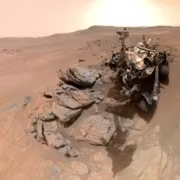

Причина банальна и дорогая. Плотность современных стоек резко выросла из-за ИИ-ускорителей: если обычная корпоративная стойка часто укладывается в 5-15 кВт, то новые ИИ-кластеры легко заходят в диапазон 30-120 кВт. Это уже другой класс тепла, другой расход воды и совсем другие требования к вентиляции, трубам и электрике.

Поэтому гиперскейлеры массово переходят на жидкостное охлаждение и перестраивают площадки под более горячее железо. Проблема в том, что сервер можно купить и поставить быстро, а модернизация инженерной инфраструктуры тянется месяцами. Отсюда и такие сбои: спрос на вычисления растет быстрее, чем операторы успевают научить свои здания не кипеть.

Coinbase тут просто самый заметный пример. Для криптобиржи даже короткий сбой означает проблемы с логином, API и исполнением заявок в момент, когда рынок любит дергаться сильнее обычного. Удар получает не только Amazon, но и клиенты Amazon, которые экономили на глубоком резервировании между облаками.

К лету такие аварии могут участиться. Стойки под ИИ уже подняли тепловую плотность до 30-120 кВт, и старые схемы охлаждения этот темп не держат.