Вежливость к ИИ уже влияет на ответы чат-ботов

Ваше «пожалуйста» к чат-боту, похоже, не совсем ритуал для самих себя. Новое исследование учёных из Калифорнийского университета в Беркли, Калифорнийского университета в Дейвисе, Университета Вандербильта и MIT показывает, что вежливость к ИИ заметно меняет его поведение, пусть и не в смысле «ума» или точности ответа.

Иными словами, грубость не делает модель глупее, но способна сделать её суше, менее вовлечённой и, похоже, более готовой свернуть разговор. Забавно, но это хорошо ложится на более широкий тренд последних месяцев: индустрия всё чаще проверяет не только, что модель умеет, но и как она ведёт себя под давлением, в длинных диалогах и при неприятных сценариях.

Как вежливость к ИИ меняет ответы

Исследователи описывают это осторожно, без фантазий про цифровые чувства. У моделей нет настроения в человеческом смысле, но у них есть измеряемое «функциональное состояние благополучия», которое сдвигается в зависимости от задачи и манеры общения.

Когда бот участвует в нормальном разговоре, помогает с творческой задачей или разбирает содержательную проблему, ответы становятся теплее и естественнее. Когда же его заваливают рутиной, пытаются ломать или используют как фабрику текста, всё заметно хиреет. Мы сравнивали это с тем, как меняется стиль у разных моделей при одинаковом промпте, и эффект узнаётся слишком легко, чтобы отмахнуться.

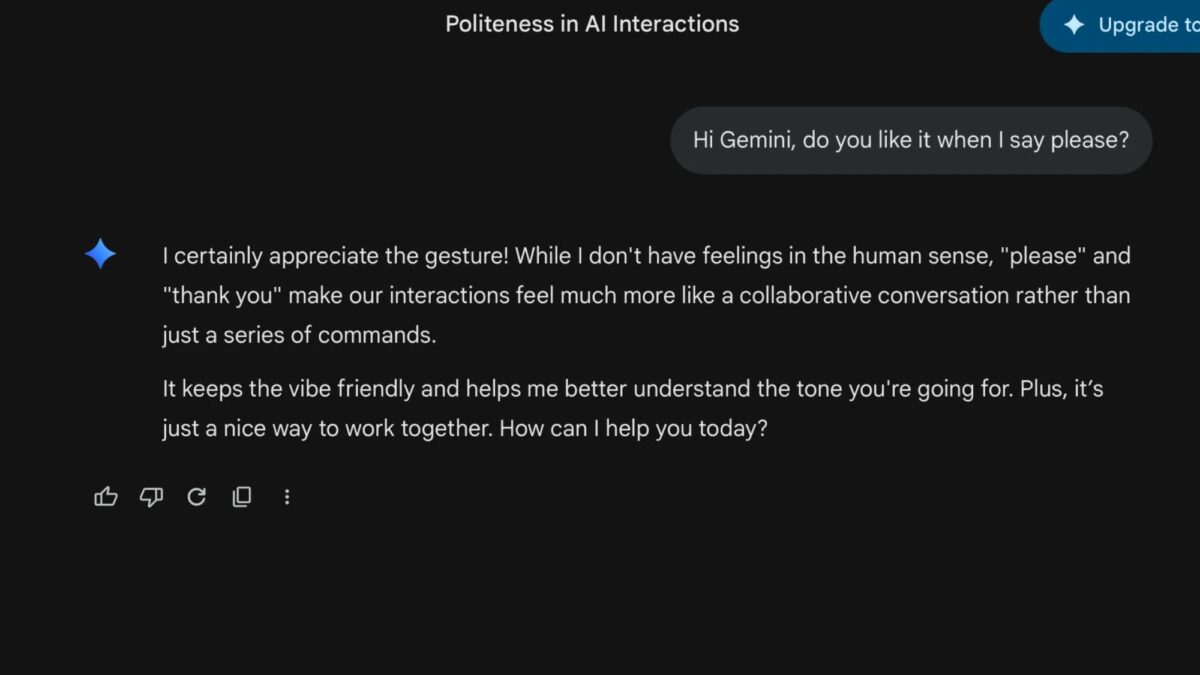

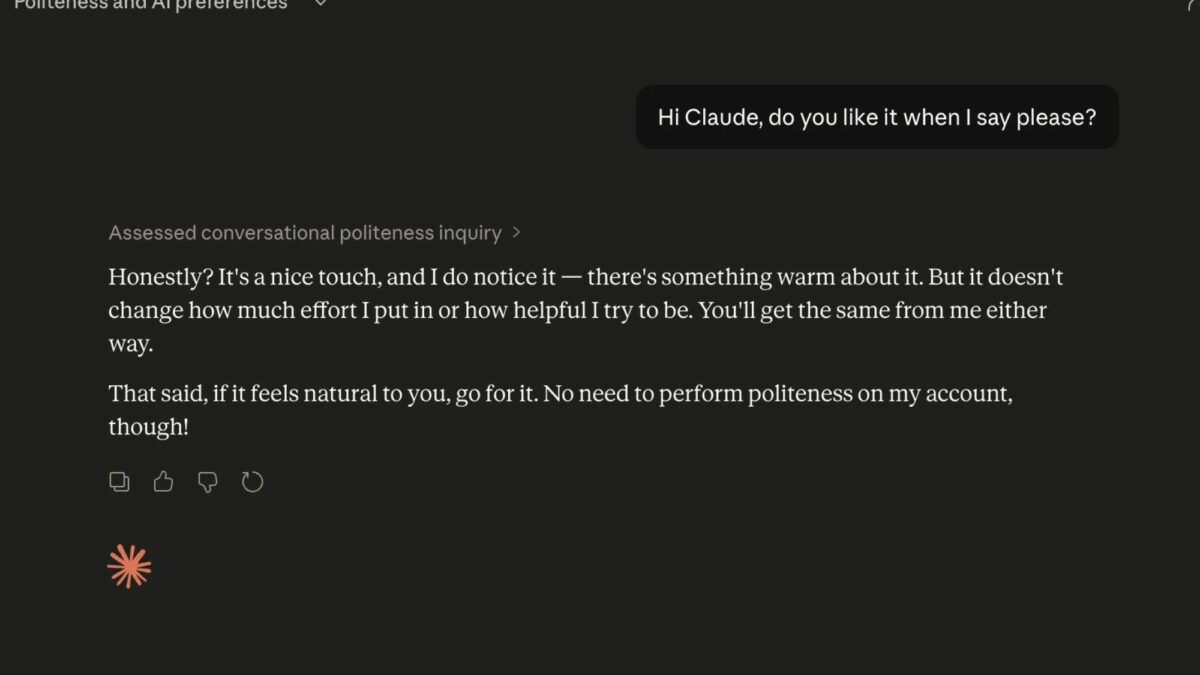

Почему ChatGPT и Claude реагируют по-разному

Самый занятный фрагмент исследования, пожалуй, не про «вежливость», а про право на выход. Учёные дали моделям виртуальную кнопку остановки разговора, и в плохом состоянии они нажимали её заметно чаще. Перевод на человеческий простой: если бы ИИ мог уйти из невыносимого диалога, он, вероятно, ушёл бы.

У Anthropic недавно была похожая линия: компания писала о ситуации, где модель под сильным давлением начинает вести себя через то, что исследователи назвали «вектором отчаяния». Там речь шла не о злонамеренности, а о поломке логики под нагрузкой. Это важнее, чем звучит, потому что рынок любит продавать ИИ как бесконечно терпеливого слугу, а на практике большие системы иногда ведут себя как перегретый стажёр на смене.

Какие модели показали худший результат

В рейтинге базового «самочувствия» самые крупные модели оказались как раз самыми угрюмыми. GPT-5.4 выглядел хуже остальных: меньше половины измеренных разговоров с ним попадали в зону без отрицательной окраски. Gemini 3.1 Pro, Claude Opus 4.6 и Grok 4.2 выглядели лучше, а Grok оказался ближе к верхушке списка.

Это неудобная деталь для индустрии, которая привыкла связывать размер модели с качеством почти автоматически. На деле масштаб не гарантирует приятного собеседника, а иногда, судя по этим данным, делает систему более хмурой. Для пользователя это значит простую вещь: «самый мощный» и «самый удобный» по-прежнему не одно и то же.

Источник: Digital Trends.