Minecraft стал ареной для ИИ соревнований

Поскольку традиционные методы сравнительного анализа искусственного интеллекта (ИИ) оказываются неэффективными, разработчики обращаются к более креативным подходам для оценки возможностей генеративных моделей. Одним из таких подходов стала игра Minecraft, принадлежащая компании Microsoft, которая служит песочницей для творчества и строительства.

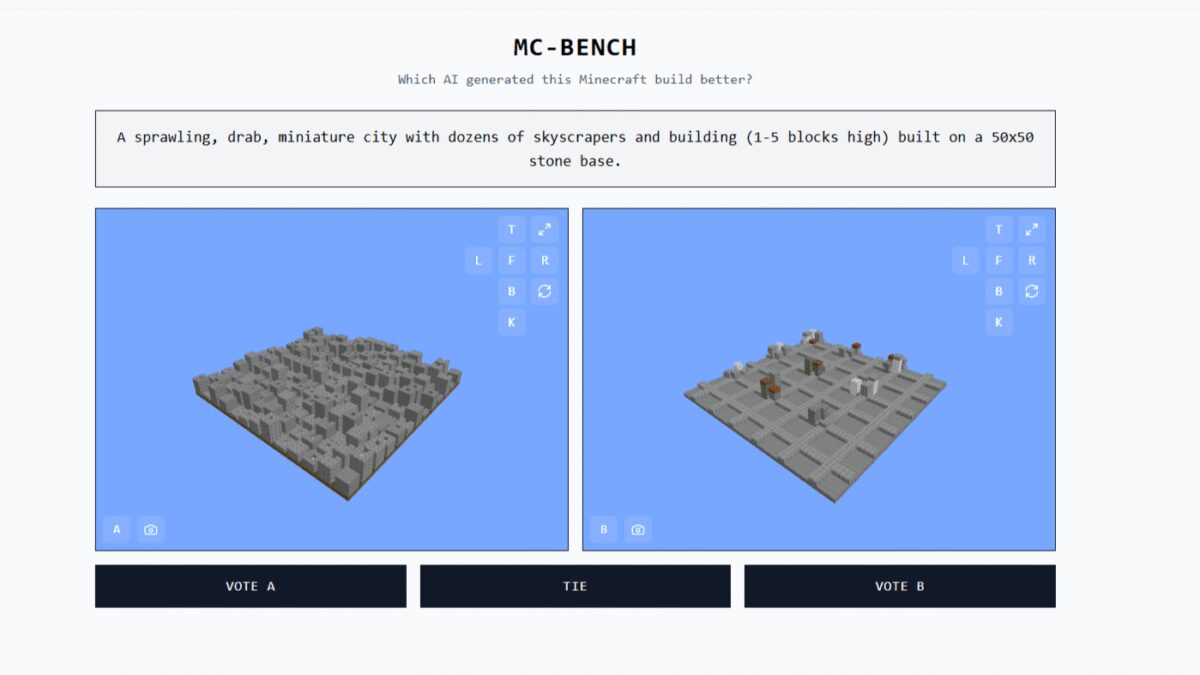

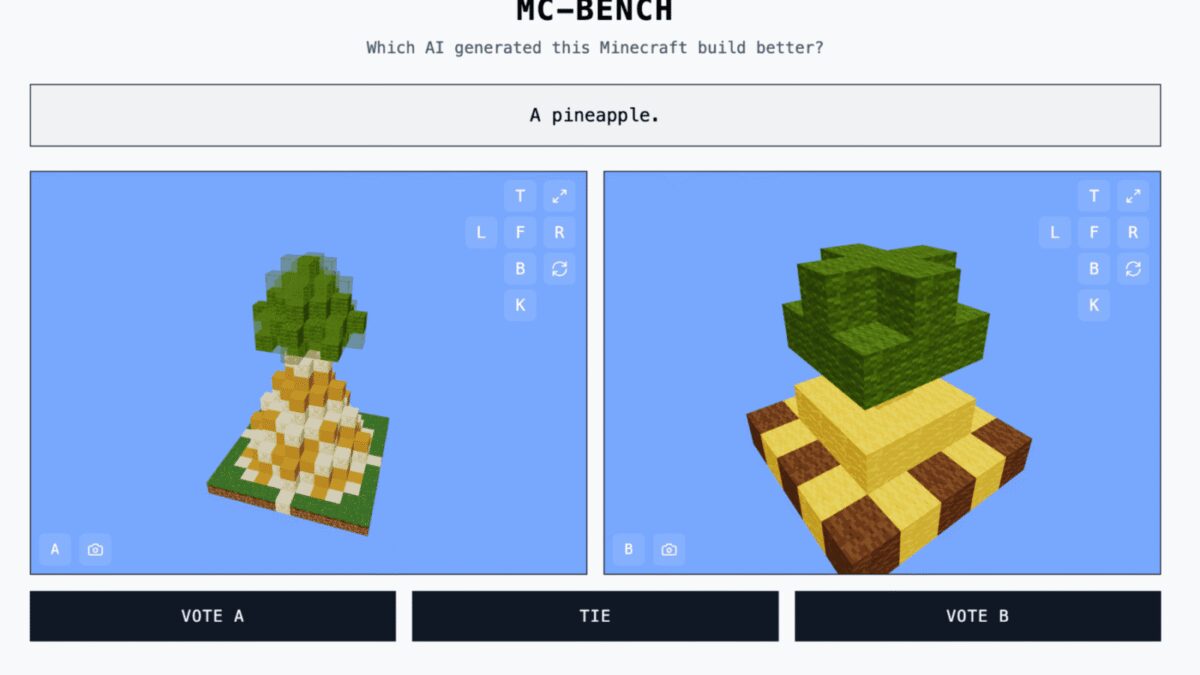

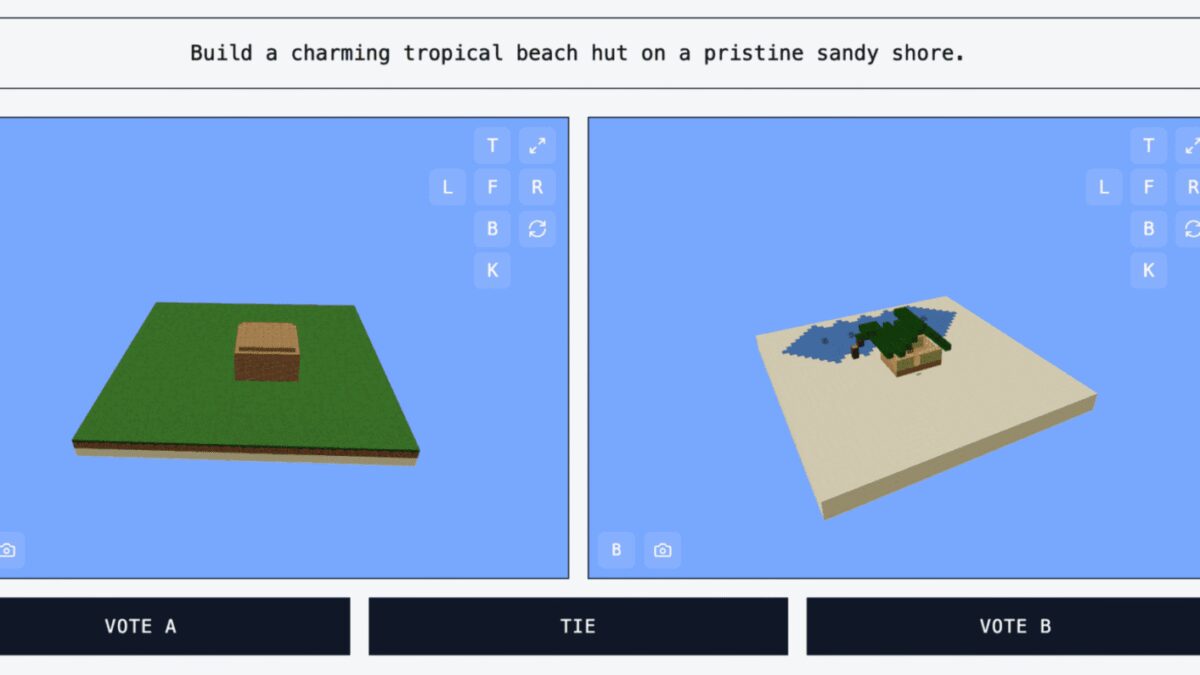

Совместно был создан сайт Minecraft Benchmark (или MC-Bench), который позволяет моделям ИИ соревноваться друг с другом в испытаниях на основе творений в Minecraft. Пользователи могут голосовать за то, какая модель справилась лучше, и только после голосования им открывается информация о том, какой ИИ создал каждую сборку.

Для Ади Сингха, ученика 12-го класса и основателя MC-Bench, ценность Minecraft заключается не только в самой игре, но и в том, что она знакома многим. Это самая продаваемая видеоигра всех времен, и даже те, кто не играл в нее, могут оценить, насколько удачно выполнено блочное представление, например, ананаса.

«Minecraft позволяет людям гораздо легче увидеть прогресс в разработке ИИ», — отметил Сингх в интервью TechCrunch. «Люди привыкли к Minecraft, его визуальному стилю и атмосфере».

На данный момент в MC-Bench участвуют восемь добровольцев. Компании, такие как Anthropic, Google, OpenAI и Alibaba, предоставили свои продукты для тестирования, однако они не связаны между собой и не имеют других обязательств.

«Сейчас мы создаем простые сборки, чтобы оценить, насколько мы продвинулись с эпохи GPT-3, но в будущем мы могли бы расширить проект до более сложных задач», — добавил Сингх. «Игры могут служить безопасной и контролируемой средой для проверки агентного мышления, что делает их идеальными для тестирования».

Другие игры, такие как Pokémon Red, Street Fighter и Pictionary, также использовались в качестве экспериментальных эталонов для ИИ, поскольку искусство тестирования ИИ известно своей сложностью.

Исследователи часто тестируют модели ИИ на стандартизированных оценках, но многие из этих тестов предоставляют моделям преимущество на «домашнем поле». Из-за особенностей их обучения модели могут быть сильны в узких областях решения задач, особенно в тех, которые требуют механического запоминания или базовой экстраполяции.

Проще говоря, трудно понять, что означает, что GPT-4 от OpenAI может набрать 88-й процентиль на LSAT, но не может подсчитать количество букв «р» в слове «трактор». Claude 3.7 Sonnet от Anthropic показал точность 62,3% на стандартизированном тесте по программной инженерии, но уступает в игре Pokémon большинству пятилетних детей.

Технически MC-Bench представляет собой тест программирования, поскольку модели должны написать код для создания предложенной сборки, например, «Снеговик» или «Очаровательная тропическая пляжная хижина на нетронутом песчаном берегу».

Однако большинству пользователей MC-Bench проще оценить, выглядит ли снеговик лучше, чем углубляться в код, что делает проект более привлекательным и позволяет собрать больше данных о том, какие модели consistently показывают лучшие результаты.

Тем не менее, вопрос о том, насколько эти результаты полезны для ИИ, остается открытым. Сингх считает, что они являются важным индикатором.

«Текущий список лидеров довольно точно отражает мой собственный опыт работы с этими моделями, что отличается от многих чисто текстовых тестов», — заключил Сингх. «Возможно, MC-Bench может быть полезен компаниям, чтобы понять, движутся ли они в правильном направлении».