GigaChat-3.1 с нативным FP8 и улучшенной генерацией без циклов

Обновлённые модели GigaChat-3.1-Ultra и Lightning вышли с важными изменениями: переход на модульную архитектуру MoE, борьба с проблемой зацикливания в генерациях и обучение DPO-этапа в нативном FP8, что повысило качество и существенно ускорило работу моделей. Улучшения сделали их конкурентоспособными с крупными аналогами на арене, а исходники остались открытыми.

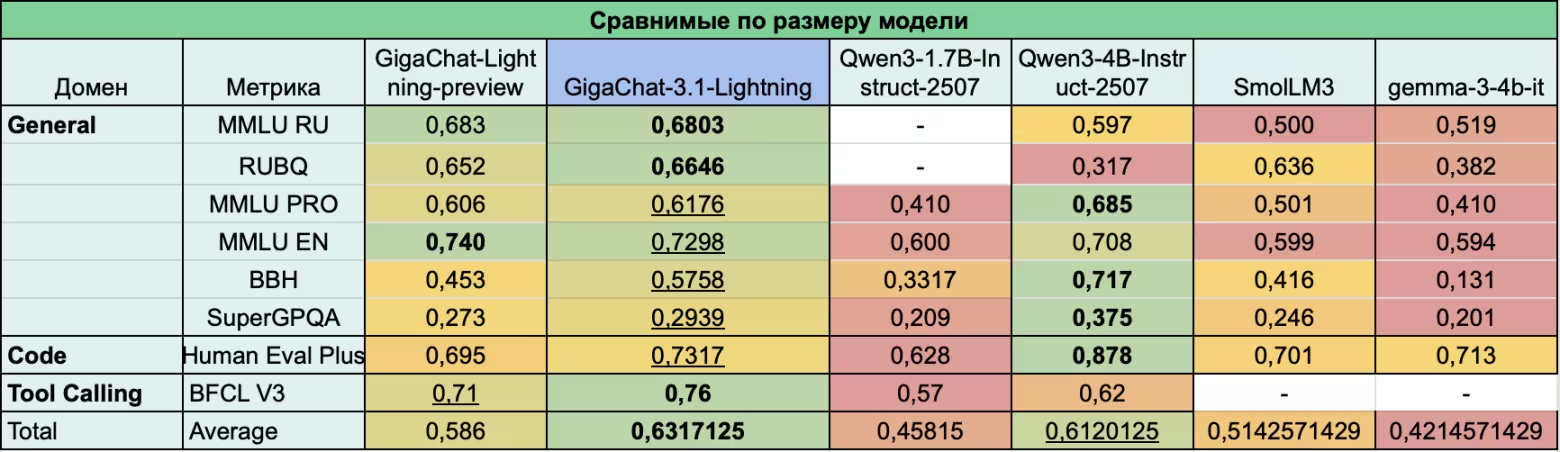

В отличие от универсальных плотных моделей, GigaChat-3.1 опирается на архитектуру с экспертами (MoE), что позволило им на старте превзойти по математике и общему рассуждению версии Qwen3 и DeepSeek. При этом Lightweight-модель с 1,8 миллиарда активных параметров демонстрирует уровень GPT-4o, что подтверждает эффективность масштабирования MoE при заметном снижении издержек на вычисления.

Решение проблемы циклов генерации с помощью новой метрики BPE-сжатия

Перед релизом команда столкнулась с зацикливанием генераций: модель повторяла слова и фразы, что портило качество ответов. Традиционная метрика CYCLES доказала свою ограниченность, и разработчики придумали новую — анализ сжимаемости хвоста текста с помощью итеративного BPE-подобного сжатия. Чем меньше длина сжатого хвоста относительно исходного, тем выше вероятность цикла. Эта универсальная метрика ловит не только прямые повторы, но и сложные шаблоны, повышая точность диагностики.

Исследование показало, что циклы возникают преимущественно на этапе претрейна с расширенным контекстом (до 32 тысяч токенов). Позже SFT и DPO уменьшают их, но грамотный подбор гиперпараметров оказался важнее самих данных. Были проверены гипотезы о проблемах с обучением предсказания EOS, дисбалансе нагрузки между экспертами и даже баге в системном языке SGLang, который увеличивал количество циклов при режиме data parallel больше 1.

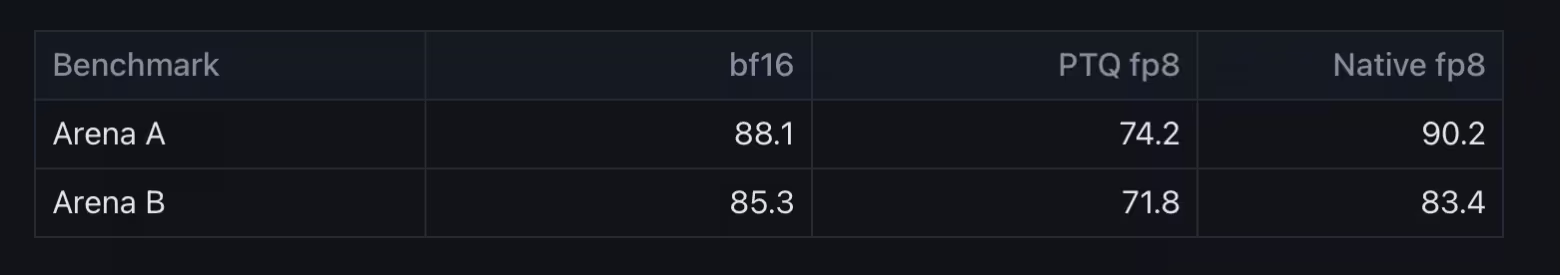

Обучение DPO в нативном FP8 и его преимущества

Впервые для этапа DPO (Direct Preference Optimization), критичного для качества alignment, была применена нативная FP8-квантизация. Ранее при использовании PTQ в FP8 модели теряли качество на сложных длинных генерациях из-за накопленных ошибок квантования в residual stream трансформера. Перевод в нативный FP8 позволил не только устранить эту проблему, но и улучшить метрики по сравнению с BF16 при вдвое меньшем потреблении памяти. Это критично для масштабных моделей с сотнями миллиардов параметров, ускоряя инференс и снижая энергозатраты.

Под капотом использовалась DeepGEMM от DeepSeek, дополненная оптимизированными CUDA и Triton-ядрами. При обучении учитывались особенности размерности слоёв для сохранения совместимости с квантованием. Это позволило гибко настраивать архитектуру и достичь высокого качества генераций. Такой подход выделяет GigaChat-3.1 на фоне многих open source моделей, которые до сих пор не отказались от более ресурсоёмкого BF16.

Оптимизация обучения и автоматизация контроля качества моделей

Ускорение обучения достигнуто оптимизацией пайплайна SFT: сочетанием sequence packing, dynamic sequence parallelism и других инженерных решений. Благодаря этому время обучения сократилось в три раза, а при обработке контекста в 256 тыс. токенов — в десять раз. Это позволяет экономить ресурсы при работе с длинными диалогами и сложными задачами, не увеличивая стоимость обучения на коротких примерах.

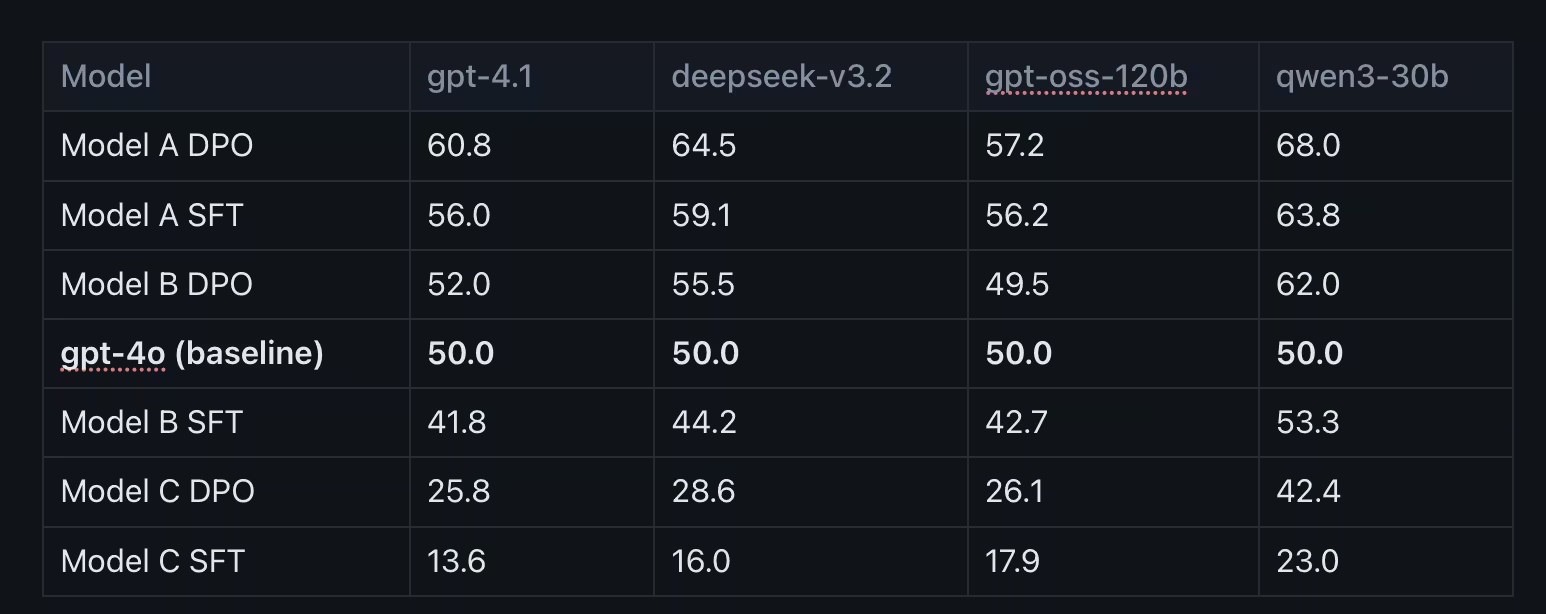

Для мониторинга качества моделей на аренах замеров внедрён оркестратор с локальными судьями. GPT-4 через API дорог, поэтому протестировали альтернативы: Qwen-3-30b завышал результаты, DeepSeek-V3.2 и Kimi-K2 были слишком тяжёлыми для быстрого тестирования. Победила GPT-OSS-120b — компактный, быстрый локальный судья с высокой корреляцией к GPT-4.

Качество и метрики моделей GigaChat-3.1 в кодировании и reasoning

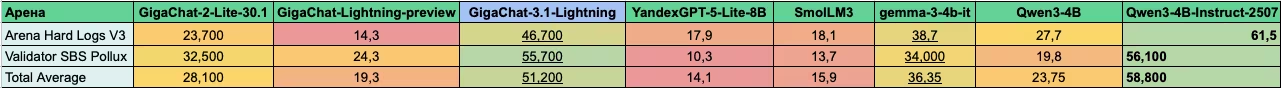

За полгода модели GigaChat значительно выросли в качестве. Ultra-версия обошла в математике и общем reasoning Qwen3-235B-A22B и DeepSeek-V3-0324, а Lightning — достигла уровня GPT-4o при вдвое меньшем объёме параметров. Вызов функций и работа с кодом особенно улучшились, Lightning теперь быстрее предшественников, сохраняя высокое качество в диалогах и программировании.

Alignment моделей стал существенно лучше благодаря глубокой работе с гиперпараметрами DPO и улучшенным наборам данных по сложным доменам — математике, физике, биологии и финансам. Персонализация теперь учитывает память пользователей, что повышает релевантность ответов без излишней навязчивости.

Размер моделей стал вдвое меньше благодаря нативному FP8, что удвоило их клиентскую нагрузку без увеличения потребления памяти и сохранило качество. Прирост скорости около 40% обеспечивает преимущество в мобильности и сервисной работе GigaChat-3.1. В сочетании с MTP (Multi-Token Prediction) это добавляет ещё больше эффективности.

В переходе на модульные MoE-модели пришлось пересмотреть не только архитектуру, но и весь пайплайн обучения — от подбора гиперпараметров до сбора и проверки данных. Сейчас команда планирует новые релизы и приглашает специалистов для решения оставшихся вызовов на пути создания крупных моделей с открытым исходным кодом.