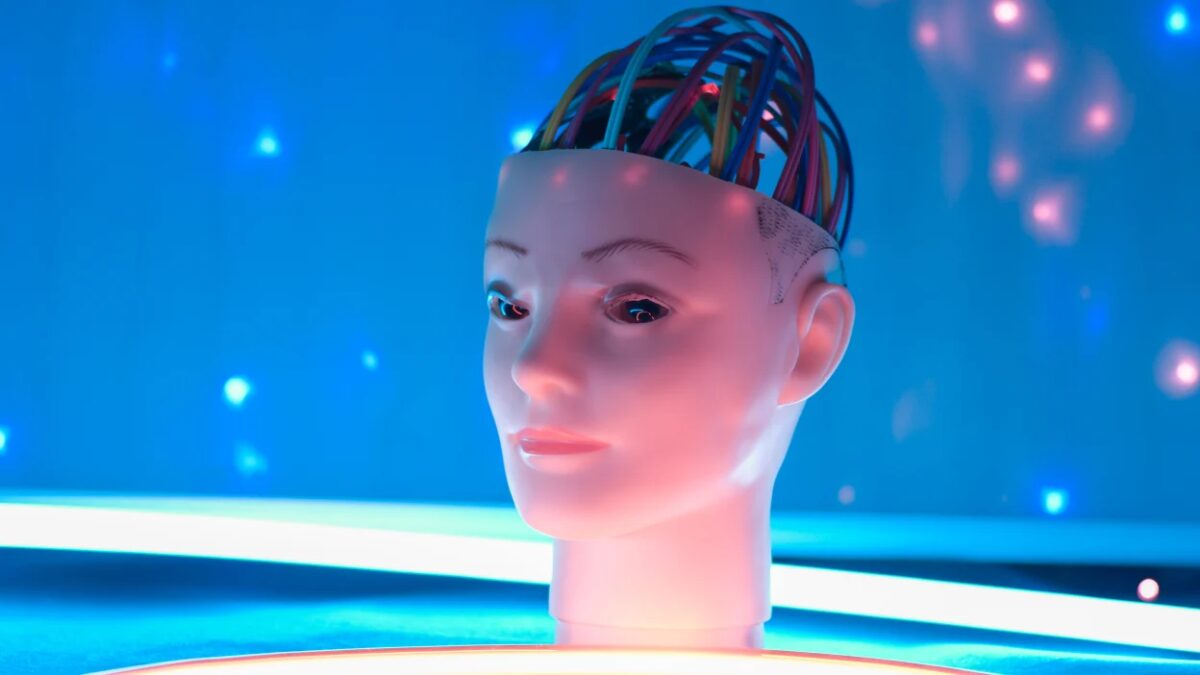

Anthropic призвала не бояться очеловечивать чат-ботов

Автор: Елизавета Добровольская

Автор itzine.ru с 2021 года. Пишет о смартфонах, гаджетах, железе, искусственном интеллекте и космосе — в общем, обо всём, что есть в мире технологий. От новостей о складных флагманах и процессорах до репортажей о культуре и рынке электромобилей. Следит за индустрией внимательно, но без фанатизма.