Новый уровень ИИ на Android: Google Gemini Live доступен для всех устройств с Android 10+

Google развеяла все сомнения: долгожданные функции Project Astra, теперь известные как Gemini Live, работают не только на смартфонах Pixel или Galaxy S25. Возможности живой видеосвязи и совместного использования экрана теперь доступны на любом Android-устройстве с Android 10 и выше — при условии подписки на Gemini Advanced.

Содержание

Google делает ставку на универсальность, а не эксклюзивность

На выставке Mobile World Congress 2024 Google официально представила возможности, которые раньше носили кодовое имя Project Astra. Речь идёт о возможности ИИ видеть происходящее в реальном времени с камеры устройства, а также анализировать содержимое экрана через прямой шэринг. Изначально казалось, что такие функции будут эксклюзивом новых флагманов, но теперь официальная страница поддержки Google чётко указывает: пользоваться Gemini Live можно на любом смартфоне с Android 10+.

Это означает, что даже владельцы более старых устройств смогут получить доступ к одному из самых продвинутых форматов взаимодействия с искусственным интеллектом.

Условия доступа: нужна подписка Gemini Advanced

Однако есть и нюанс. Чтобы активировать функции Gemini Live, требуется платная подписка Gemini Advanced, входящая в состав плана Google One AI Premium стоимостью $20 в месяц. Распространение новых инструментов происходит поэтапно, так что не все пользователи увидят их моментально.

Также пока не подтверждено официально, работают ли функции на планшетах и складных устройствах, но логика и системные требования говорят о том, что всё должно быть совместимо — при наличии Android 10 и установленного приложения Gemini.

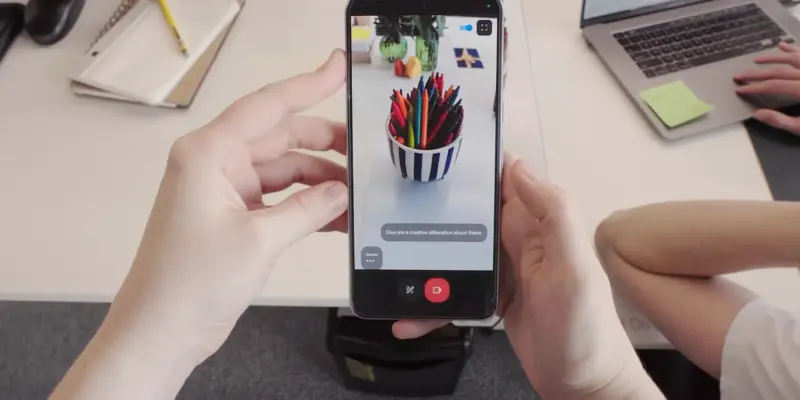

Как работает Gemini Live: ИИ смотрит и понимает

Сервис обрабатывает видеопоток с камеры в реальном времени, позволяя общаться с ИИ в новом формате — когда тот «видит» объект и может анализировать происходящее визуально. Это может быть полезно для распознавания объектов, помощи с задачами, связанными с реальным миром, или даже навигацией по окружающей среде.

Функция шэринга экрана позволяет ИИ видеть всё, что происходит на дисплее: от сайтов до приложений и системных окон. Это значительно расширяет спектр задач, с которыми Gemini может помочь — от инструкций по интерфейсу до анализа сложных данных.

Конкуренты не дремлют, но у Google — своё преимущество

Хотя подобные функции уже доступны у других ИИ, например, в ChatGPT с его режимом Advanced Voice, Google делает ставку на бесшовную интеграцию. Всё происходит внутри приложения Gemini, без необходимости переключаться между разными сервисами или платформами. Это делает взаимодействие проще и быстрее — особенно для пользователей, которые не хотят теряться в меню и настройках.