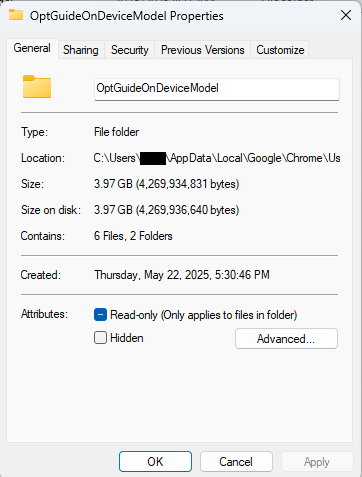

Chrome начал молча скачивать на компьютеры пользователей локальную модель Gemini Nano весом около 4 ГБ. Исследователь безопасности Александр Ханфф, известный как ThatPrivacyGuy, обнаружил, что браузер кладет файл weights.bin в папку OptGuideOnDeviceModel внутри профиля Chrome, если устройство проходит по железу. Никакого запроса, никакого уведомления. Удаляете файл вручную, браузер может скачать его снова.

На безлимитном домашнем интернете это выглядит как очередная фоновая возня Chrome. На лимитном тарифе, мобильной точке доступа или в стране, где трафик до сих пор считают по гигабайтам, это уже счет за чужую инициативу. И тут дело даже не в самих 4 ГБ. Chrome держит примерно две трети мирового браузерного рынка, так что даже частичный rollout превращается в сотни петабайт лишнего трафика.

Файл относится к Gemini Nano, компактной локальной модели Google. Chrome использует ее для функций вроде «Help me write», локального распознавания мошеннических страниц и Summarizer API, через который сайты могут вызывать встроенное резюмирование текста. Google двигает такие AI API в Chrome с 2024 года, потому что идея красивая: часть задач выполняется на устройстве, а не в облаке, и браузер получает еще один повод глубже залезть в систему.

Проблема в том, что локальная модель не равна локальной приватности по умолчанию. По анализу Ханффа, самый заметный AI-элемент в Chrome, «AI Mode» в адресной строке, отправляет запросы в облако Google. Для пользователя картина выходит типично корпоративная: на диск уже что-то положили, место уже заняли, а какие именно запросы остаются локальными, а какие улетают на сервер, надо выяснять с лупой.

Ханфф отдельно посчитал экологическую цену такой тихой раздачи. Если модель уйдет хотя бы на 1 млрд устройств, одна только доставка, без реального использования, потянет примерно на 240 ГВт·ч и 60 000 тонн CO2-эквивалента. Можно спорить о методике, но порядок цифр здесь важнее точности до запятой: AI-функции в браузере начинают вести себя как крупный дистрибутив, хотя пользователю их продают как маленькое «удобное улучшение».

Проверка простая. На Windows нужно открыть проводник и вставить в адресную строку путь %LOCALAPPDATA%\Google\Chrome\User Data. На Mac путь такой: ~/Library/Application Support/Google/Chrome/. Если внутри есть папка OptGuideOnDeviceModel, модель, скорее всего, уже лежит на диске.

Само наличие папки не означает заражение. Это не вредоносный код, а штатный компонент AI-функций Chrome. Но тут и скрыт самый неприятный момент: спор идет не о вирусе, а о праве браузера без спроса расходовать ваш диск, ваш канал и ваше электричество. Технически аккуратная установка без согласия все равно остается установкой без согласия.

Самый безопасный способ для обычного пользователя такой: открыть в Chrome страницу chrome://settings/ai и выключить AI-функции прямо там. В разных версиях и регионах названия переключателей отличаются, но обычно речь идет о «Help me write», AI-сводках и локальных AI-возможностях. После этого браузер лучше перезапустить.

Удалять папку вручную можно, но это не всегда оправдано. Если Chrome считает, что функция ему снова нужна, файл может вернуться после обновления. Советы лезть в реестр Windows или корпоративные политики существуют, но для домашнего пользователя это уже путь в знакомый техноабсурд: чтобы запретить браузеру тихо ставить AI, нужно администрировать ОС как в офисе на тысячу сотрудников.

Юридическая часть тоже пахнет плохо. Ханфф считает, что такая схема может конфликтовать с европейскими правилами ePrivacy и GDPR из-за хранения данных на устройстве и слабой прозрачности. И история не единичная: несколько недель назад он же описывал, как Claude Desktop раскидывал интеграционные файлы по Chromium-браузерам без внятного предупреждения. У AI-компаний быстро формируется дурная привычка считать пользовательский компьютер полигоном для развертывания «полезных» функций.

Июньский релиз Chrome станет удобной точкой проверки: либо Google добавит явное согласие на загрузку модели, либо спор о 4 ГБ уйдет из техфорумов в папки европейских регуляторов.